Découvrez les six priorités clés identifiées pour la gouvernance de l’IA dans le domaine militaire, lors de la rencontre RAISE de 2024, avec un focus stratégique et scientifique.

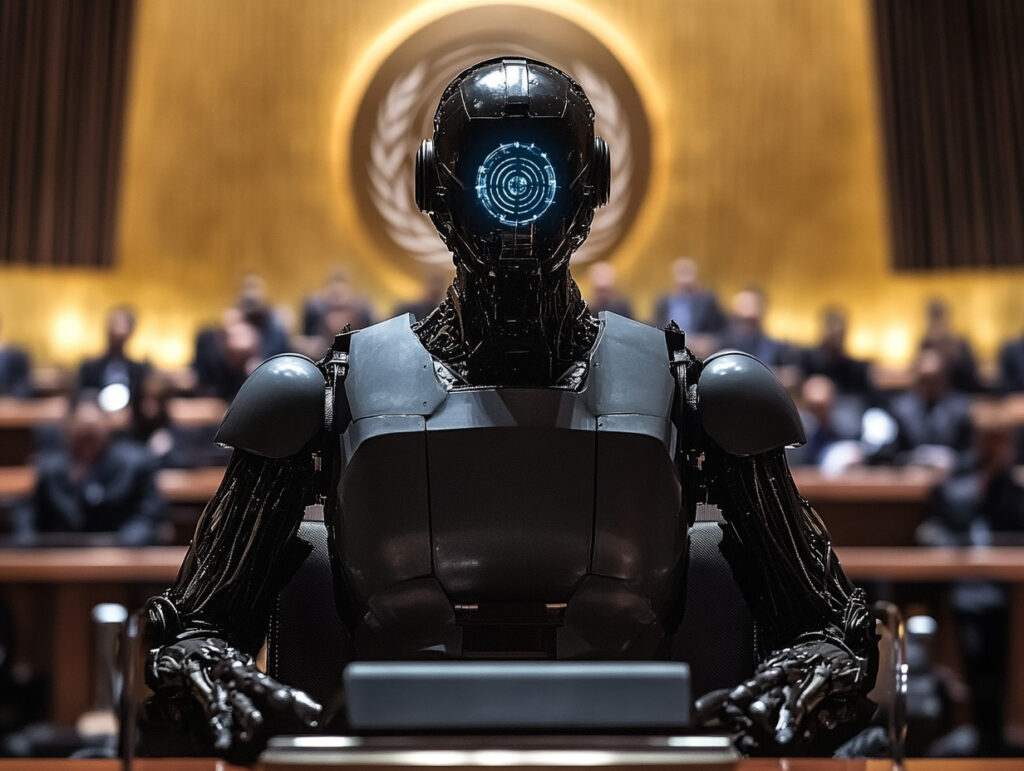

En mars 2024, l’initiative RAISE a été lancée par UNIDIR, en collaboration avec Microsoft, pour aborder la gouvernance de l’IA dans la sécurité et la défense, en mettant l’accent sur les applications militaires. Cet événement a permis d’identifier six priorités essentielles : création d’une base de connaissances, construction de la confiance, rôle de l’humain dans l’utilisation de l’IA, pratiques de gestion des données, gestion du cycle de vie, et risques de déstabilisation. Ces priorités serviront de cadre pour des recommandations politiques futures, avec une coopération multi-sectorielle. L’article explore ces points en détail.

Lancement de l’initiative RAISE

En mars 2024, la table ronde sur l’intelligence artificielle, la sécurité et l’éthique (RAISE) a été officiellement lancée à Bellagio, en Italie. Cette initiative, dirigée par UNIDIR (United Nations Institute for Disarmament Research), en partenariat avec Microsoft, vise à créer une plateforme neutre et inclusive pour discuter de l’impact de l’intelligence artificielle (IA) dans les domaines de la sécurité et de la défense. Ce projet est conçu pour rassembler des acteurs de divers secteurs, incluant la recherche, l’industrie et les gouvernements.

L’objectif de RAISE est de répondre à la montée rapide de l’utilisation de l’IA dans les contextes militaires, un domaine en constante expansion. Selon un rapport de MarketsandMarkets, le marché mondial de l’IA militaire atteindrait 11,6 milliards d’euros d’ici 2027, avec un taux de croissance annuel composé (CAGR) de 14,6 %. Cette progression rapide souligne l’urgence de définir des normes et des cadres politiques solides pour éviter les risques de mauvaise utilisation de cette technologie.

Analyse des applications de l’IA dans la sécurité et la défense

L’événement inaugural de RAISE a permis de passer en revue l’état actuel des applications de l’IA dans les contextes de sécurité et de défense, avec un accent particulier sur le domaine militaire. Dans ce secteur, l’IA est utilisée pour améliorer plusieurs aspects des opérations militaires, tels que :

- La gestion autonome des drones : L’intégration de l’IA dans les systèmes de drones permet de réduire la dépendance humaine et d’augmenter la précision des missions. Par exemple, les drones autonomes peuvent exécuter des missions de reconnaissance ou de frappe avec une intervention humaine minimale.

- L’analyse prédictive : Les algorithmes d’IA sont utilisés pour analyser de grandes quantités de données en temps réel et prédire les mouvements de l’ennemi, augmentant ainsi l’efficacité des stratégies militaires.

Les défis majeurs dans l’utilisation de l’IA en milieu militaire concernent la fiabilité des systèmes et l’interopérabilité entre les différents pays et organisations. Un cadre de coopération internationale est essentiel pour éviter les scénarios où des systèmes d’IA concurrents entraînent des escalades involontaires dans les conflits.

Les six priorités stratégiques identifiées

L’un des résultats clés de la rencontre RAISE a été l’identification de six priorités pour guider le développement de la gouvernance de l’IA dans le domaine militaire :

1. Création d’une base de connaissances

La première priorité est de créer une base de connaissances solide et partagée, où les parties prenantes peuvent accéder aux dernières recherches et développements en matière d’IA militaire. L’absence d’une telle base augmente le risque d’utilisation non réglementée de l’IA.

Cette base doit inclure des informations techniques, des études de cas, et des cadres éthiques pour garantir une application responsable. Par exemple, l’étude de la gestion des drones autonomes en zone de guerre peut fournir des informations cruciales pour l’implémentation de règles de sécurité.

2. Construction de la confiance

La confiance entre les différents acteurs – industriels, militaires, et civils – est cruciale pour assurer un déploiement sécurisé de l’IA. La transparence des algorithmes, des données, et des décisions prises par les systèmes d’IA est un élément central. Un système opaque peut entraîner une perte de confiance et exacerber les tensions internationales.

Un exemple pratique est l’utilisation des systèmes d’IA dans la reconnaissance faciale, qui peut générer des erreurs si les algorithmes sont biaisés. Il est essentiel de s’assurer que ces systèmes sont testés et validés pour éviter des erreurs coûteuses.

3. Le rôle de l’humain dans l’utilisation de l’IA

Même avec une automatisation accrue, l’élément humain reste crucial dans la supervision et la prise de décision en matière d’IA militaire. Le concept de “l’humain dans la boucle” implique que l’humain ait toujours le dernier mot dans des situations critiques, comme les frappes de drones.

Ce principe est vital pour garantir que les actions militaires respectent les lois internationales et les droits humains. Il est également nécessaire de former les opérateurs humains à travailler avec des systèmes d’IA complexes, ce qui pourrait représenter un investissement de plusieurs millions d’euros dans les formations techniques et éthiques.

Les pratiques de gestion des données

La gestion des données est une priorité majeure, car l’efficacité des systèmes d’IA dépend directement de la qualité et de l’accessibilité des données. Des données incorrectes ou biaisées peuvent fausser les décisions des systèmes d’IA militaires, entraînant des conséquences potentiellement dangereuses.

Par exemple, les systèmes d’IA utilisés dans la reconnaissance de cibles doivent être alimentés avec des données précises pour éviter des dommages collatéraux. Une mauvaise gestion des données pourrait aussi nuire à la crédibilité des systèmes d’IA sur le plan international.

Gestion du cycle de vie et déstabilisation

Enfin, la gestion du cycle de vie des systèmes d’IA, de leur conception à leur décommissionnement, et la déstabilisation liée à l’adoption de nouvelles technologies sont des aspects cruciaux à considérer. Les systèmes d’IA évoluent rapidement et leur utilisation à long terme soulève des questions de maintenance, de mise à jour, et de sécurité.

Par exemple, l’intégration de nouvelles fonctionnalités dans des systèmes d’armement autonomes nécessite un suivi régulier pour éviter les failles de sécurité. De plus, la déstabilisation peut résulter de la dissémination incontrôlée de ces technologies, notamment si elles tombent entre les mains d’acteurs non étatiques ou malveillants.

Conséquences et implications globales

Les six priorités identifiées lors de la réunion RAISE peuvent potentiellement remodeler la manière dont l’IA est gouvernée dans le domaine militaire. Les implications de ces développements sont vastes, affectant non seulement la sécurité mondiale mais aussi les relations géopolitiques.

L’absence de gouvernance et de règles claires pourrait entraîner des dérives graves, notamment dans les conflits asymétriques, où des acteurs non étatiques pourraient exploiter des systèmes d’IA peu régulés. Les gouvernements et les industries doivent collaborer pour définir un cadre qui minimise les risques tout en maximisant les avantages de l’IA pour la sécurité collective.

Avion-Chasse.fr est un site d’information indépendant.